La cara invisible de la Inteligencia Artificial: el costo humano detrás del entrenamiento

La cara invisible de la Inteligencia Artificial es un tema que en EmpowerTIC si estamos dispuestos a conversar. Desde nuestros inicios hemos insistido en que la inteligencia artificial no es solo una revolución tecnológica; es también un fenómeno social, político y profundamente humano. Cada vez que utilizamos un chatbot, generamos imágenes con IA o recibimos recomendaciones automáticas en una plataforma digital, solemos pensar que estamos frente a un sistema autónomo capaz de aprender por sí mismo. Estos temas pueden resultar incómodos y algo increíbles, por eso nuestra misión es clara: Fortalecer competencias digitales a lo largo de la vida

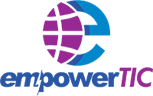

Sin embargo, detrás de esa aparente autonomía existe una realidad mucho más compleja. La ética de la inteligencia artificial nos obliga a mirar más allá del código y preguntarnos quién hace posible que estos sistemas funcionen. Investigaciones recientes, como el reportaje realizado por DW Español sobre el trabajo de etiquetadores de datos en Kenia, revelan una dimensión poco visible de la industria tecnológica: miles de trabajadores del Sur Global que entrenan, corrigen y “limpian” los sistemas de IA para que estos puedan interactuar con el mundo.

Comprender esta realidad es fundamental para quienes investigamos, enseñamos o utilizamos tecnologías emergentes. La IA no nace de la nada; se construye a partir de conocimiento humano, trabajo intensivo y decisiones éticas que afectan a millones de personas.

La base humana de la inteligencia artificial

Para que un sistema de inteligencia artificial pueda reconocer patrones o interpretar información, primero debe ser entrenado con grandes volúmenes de datos. Este proceso implica que miles de personas clasifiquen imágenes, textos y sonidos para enseñar a los algoritmos a distinguir entre objetos, conceptos o comportamientos.

Este proceso se conoce como etiquetado de datos. Gracias a él, una IA puede aprender que ciertas características corresponden a un gato y otras a un perro, o reconocer señales de tráfico, peatones y edificios en una ciudad.

Un caso ilustrativo es el de trabajadores en Kenia que han dedicado años a mapear calles, vehículos y señales de tráfico de ciudades como San Francisco para entrenar sistemas de navegación autónoma. Paradójicamente, muchos de ellos nunca han visitado los lugares que ayudan a digitalizar.

Esta labor demuestra que la inteligencia artificial no es realmente “artificial” en su origen. Es, en gran medida, conocimiento humano sistematizado y transformado en datos computacionales.

El entrenamiento moral de los algoritmos

Los modelos de lenguaje actuales no solo necesitan aprender a reconocer patrones, sino también a distinguir entre lo aceptable y lo problemático en la comunicación humana.

Para lograrlo, empresas tecnológicas contratan a analistas que revisan conversaciones, textos o imágenes potencialmente sensibles para enseñar a los sistemas qué tipo de contenido debe ser moderado o rechazado.

Esta tarea, conocida informalmente como entrenamiento moral, implica analizar material que puede incluir violencia, discursos de odio o contenidos perturbadores. Los trabajadores deben evaluar contextos complejos y decidir cuándo una información es legítima por ejemplo, en un contexto histórico o académico y cuándo debe ser restringida.

Investigaciones académicas han advertido que esta labor puede generar impactos psicológicos significativos en quienes la realizan, especialmente cuando se enfrentan diariamente a contenido extremo (Gray & Suri, 2019).

La brecha económica en la industria de datos

Uno de los aspectos más debatidos en la ética de la inteligencia artificial es la desigual distribución de los beneficios económicos de esta industria.

Mientras empresas tecnológicas alcanzan valoraciones multimillonarias gracias al desarrollo de modelos avanzados de IA, muchos de los trabajadores encargados de preparar los datos reciben pagos muy bajos por tarea o por hora.

Diversos estudios han señalado que esta dinámica reproduce desigualdades globales: gran parte del trabajo de etiquetado de datos se realiza en países del Sur Global, donde los costos laborales son menores y la regulación laboral suele ser más débil (Graham, Hjorth & Lehdonvirta, 2017).

Esta situación plantea una pregunta central: ¿puede considerarse sostenible una innovación tecnológica que depende de una cadena de valor tan desigual?

La invisibilidad del trabajo digital

Otro problema estructural es la manera en que este tipo de trabajo es percibido socialmente. En muchas ocasiones, el etiquetado de datos se clasifica como “trabajo no cualificado”, lo que reduce su reconocimiento profesional y limita las oportunidades de mejora laboral.

No obstante, el proceso exige habilidades cognitivas importantes: interpretación contextual, análisis crítico de contenidos, toma de decisiones éticas y atención a detalles complejos.

La sociología del trabajo digital ha demostrado que esta invisibilización no es casual. Forma parte de una estructura económica donde ciertas tareas esenciales para el funcionamiento de las plataformas permanecen ocultas para el público (Casilli, 2019).

Reconocer este trabajo es fundamental para comprender cómo realmente funciona la economía digital.

La fragilidad laboral en las plataformas tecnológicas

Además de los bajos ingresos, muchos trabajadores de datos enfrentan condiciones laborales inestables. La contratación suele realizarse a través de plataformas digitales que pueden suspender cuentas o cancelar proyectos de manera repentina.

En algunos casos documentados, empresas han cerrado operaciones en determinadas regiones sin previo aviso, dejando a miles de trabajadores sin ingresos ni compensación.

Este fenómeno refleja una característica más amplia del trabajo en plataformas: la deslocalización y automatización de la gestión laboral mediante algoritmos, lo que dificulta la organización colectiva y la protección de derechos laborales.

Repensar el futuro de la inteligencia artificial

La inteligencia artificial representa una de las transformaciones tecnológicas más importantes de nuestra época. Sin embargo, su desarrollo no puede evaluarse únicamente desde la eficiencia técnica o el impacto económico.

La ética de la inteligencia artificial nos obliga a considerar también las condiciones humanas que hacen posible su funcionamiento. Desde los investigadores hasta los usuarios cotidianos, todos formamos parte del ecosistema que legitima estas tecnologías.

Esto implica promover prácticas más responsables: mayor transparencia en las cadenas de producción de datos, condiciones laborales dignas para quienes entrenan los sistemas y marcos regulatorios que protejan a los trabajadores digitales.

Al final la IA no es una entidad autónoma

La inteligencia artificial no es una entidad autónoma ni una “deidad tecnológica”. Es el resultado de millones de decisiones humanas, de trabajo intelectual distribuido globalmente y de una infraestructura social que muchas veces permanece invisible.

Comprender esta dimensión humana es clave para construir una innovación verdaderamente responsable. Si queremos que la IA contribuya a un futuro más justo y sostenible, debemos reconocer a quienes están detrás de su desarrollo y exigir modelos tecnológicos más éticos.

En EmpowerTIC creemos que la tecnología debe servir para ampliar las oportunidades humanas, no para ocultar nuevas formas de desigualdad. Por eso seguimos promoviendo una mirada crítica, ética y transformadora sobre la inteligencia artificial y su impacto en la educación, la investigación y la sociedad.

Si este tema te interesa, te invitamos a seguir nuestras publicaciones en EmpowerTIC y formar parte de una comunidad que reflexiona, aprende y construye el futuro digital con responsabilidad.

Si deseas conocer más acerca de este tema: El lado oscuro de la IA : OpenAI y Meta demandadas por robar obras protegidas para entrenar sus robots inteligentes – empowerTIC

Fuente original: DW Español. (2025, 25 de enero). Trabajadores de datos: el costo humano de la inteligencia [Video]. YouTube. https://youtu.be/hw7kVyxaPD0?list=TLGGFuh3ytRwpvcxNDAzMjAyNg

Post Info :

Nuestras redes

Post Populares

Mujeres emprendedoras: historias que transforman

La motivación en educación virtual en 2026: un plus que marca la diferencia ( 1era parte)

7 ideas probadas para ganar dinero en el 2026: ¡el mundo online dice presente!